Was Hiring-Teams mit Blick auf 2026 wissen sollten

Noch vor ein paar Jahren stellten sich viele Personalverantwortliche vor allem eine Frage:

Sollten wir KI überhaupt im Recruiting einsetzen?

Heute lautet die Frage eine ganz andere.

Denn fast alle tun es bereits.

Lebenslauf-Screening, Chatbots, automatisierte Assessments, Ranking-Tools – KI hat sich leise in frühe Phasen des Einstellungsprozesses eingebaut. Das World Economic Forum schätzt, dass inzwischen fast 90 % der Unternehmen in irgendeiner Form KI im Recruiting nutzen – oft ohne sich im Detail anzusehen, was im Hintergrund eigentlich passiert.

Gleichzeitig hat sich jedoch etwas Entscheidendes verändert.

Regulierungsbehörden, Kandidaten sowie Unternehmensleitungen fragen nicht mehr nur, ob KI Zeit spart.

Sie stellen schwierigere Fragen:

- Können wir erklären, wie das funktioniert?

- Ist das fair?

- Würden wir diese Entscheidungen verteidigen, wenn wir müssten?

Genau das ist der Wendepunkt. KI im Recruiting geht längst über Effizienz hinaus – sie steht zunehmend unter regulatorischer und unternehmensweiter Aufsicht.

Die Fragen, die ich immer wieder höre

In den vergangenen zwölf Monaten ist mir in Gesprächen mit großen Arbeitgebern ein klares Muster aufgefallen.

Es geht kaum noch um Features.

Es geht um Risiko.

- Dürfen wir diese KI überhaupt einsetzen?

- Was passiert, wenn eine Kandidatin eine Entscheidung anfechtet?

- Können wir das System gegenüber Legal, Einkauf oder einer Aufsichtsbehörde verständlich erklären?

Ein Teil davon ist regulatorisch getrieben – etwa durch New York Citys Local Law 144, den EU AI Act oder ähnliche Regelwerke weltweit. Doch vieles kommt auch aus dem Markt selbst.

Juristische Abteilungen, Procurement-Teams, KI-Gremien und Vorstände sind heute viel stärker in Technologieentscheidungen eingebunden als noch vor zwei Jahren.

Kurz gesagt: Recruiting-Technologie wird nicht mehr nur danach bewertet, wie schnell sie ist – sondern danach, ob sie vertretbar ist.

Die Unterscheidung, die plötzlich entscheidend wird

Je genauer hingeschaut wird, desto wichtiger wird eine zentrale Frage:

Setzen Sie KI ein, die ihre Logik verbirgt – oder KI, die transparent arbeitet und die menschliche Kontrolle stärkt?

Genau hier verläuft die Grenze zwischen Black-Box-Screening und verantwortungsvollen und regelkonformen Einsatz von KI.

Was mit „Black-Box“ meist gemeint ist

Die wenigsten sprechen im Alltag vom Begriff „Black Box“. Doch die meisten erkennen sofort, was gemeint ist.

Es geht um Systeme, die Scores oder Rankings erzeugen, ohne nachvollziehbar zu machen, wie sie zustande kommen. Bewerbende erhalten Absagen mit kaum erklärbaren Gründen. Recruiter können schwer erkennen, welche Faktoren den Ausschlag gegeben haben. Mit der Zeit fühlt sich das Ergebnis wie eine Entscheidung an – selbst wenn es offiziell nur als „Empfehlung“ bezeichnet wird.

Das Problem ist nicht Automatisierung. Das Problem ist Intransparenz.

Wenn niemand erklären kann, wie ein System arbeitet, lässt es sich nicht verteidigen. Genau dort beginnen rechtliche, ethische und reputative Risiken – oft leise, bis irgendwann ein Problem öffentlich wird.

Wie regelkonform eingesetzte KI in der Praxis aussieht

Regelkonform eingesetzte KI funktioniert grundlegend anders.

Kandidaten wissen, dass KI beteiligt ist. Sie verstehen, was bewertet wird. Recruiter können nachvollziehen, wie Empfehlungen entstehen und warum. Die Systeme lassen sich auditieren. Und vor allem: Die finale Entscheidung bleibt immer beim Menschen.

Diese Systeme konzentrieren sich zudem auf das, was für die Rolle wirklich relevant ist: Fähigkeiten, Erfahrung, Qualifikationen – nicht spekulative Merkmale wie Persönlichkeitsprofile oder schwammige Vorstellungen von „Cultural Fit“.

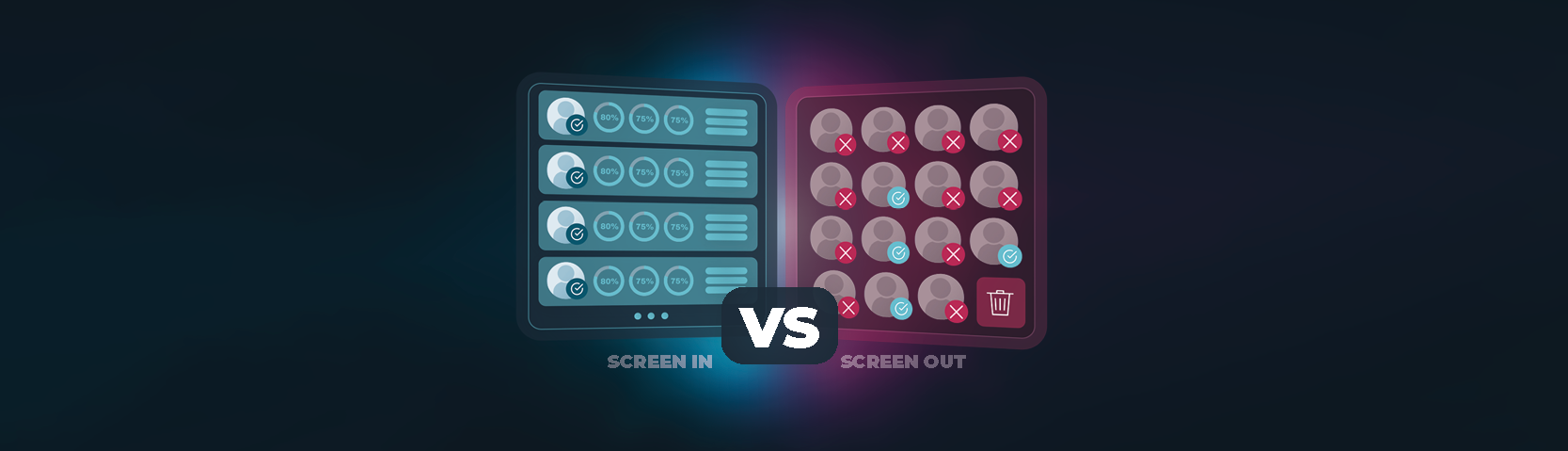

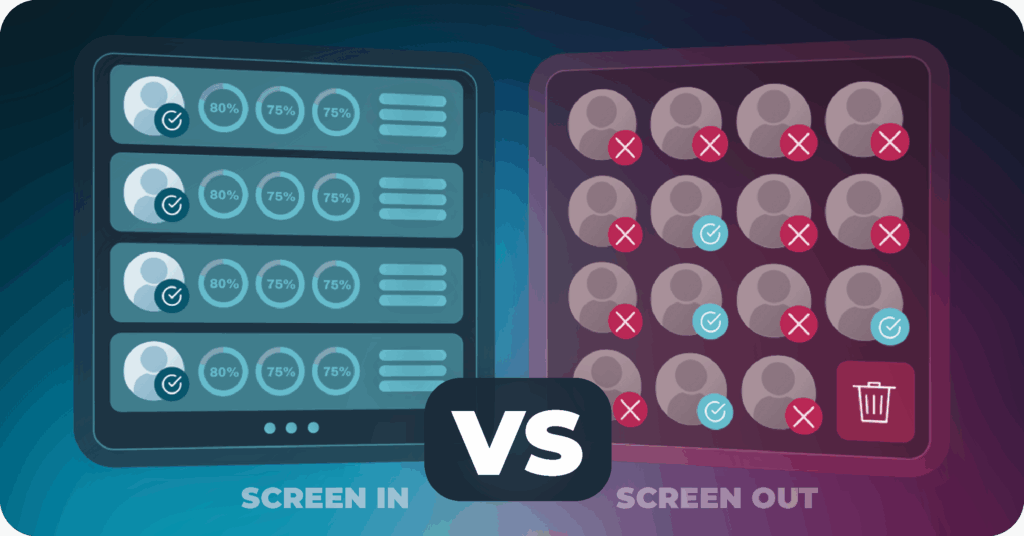

Ein Prinzip ist dabei besonders wichtig: Menschen hinein-, nicht hinaus-screenen.

Statt Bewerbende früh auf Basis dünner Daten auszusortieren, sammeln solche Systeme mehr Informationen. Sie stellen Nachfragen. Sie erkennen Lücken. Sie geben Menschen die Chance zu zeigen, was sie wirklich können.

Für Kandidaten fühlt sich das transparenter und fairer an. Für Arbeitgeber ist es deutlich leichter, solche Prozesse zu vertreten.

Ein kurzer Selbsttest

Wenn Sie KI im Recruiting einsetzen – mit Blick auf 2026 und darüber hinaus – sollten Sie folgende Fragen ohne Zögern beantworten können:

- Wissen Bewerbende, dass KI eingesetzt wird?

- Können wir die Logik in verständlicher Sprache erklären?

- Können Recruiter Empfehlungen prüfen und auditieren?

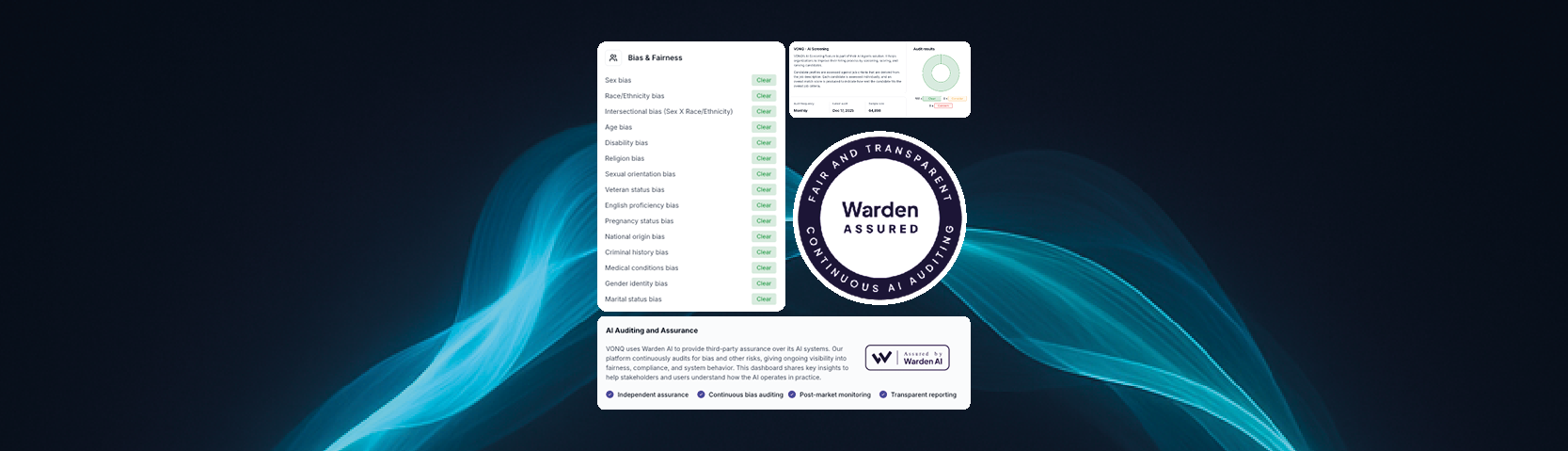

- Gibt es unabhängige Nachweise für Fairness- und Bias-Tests?

- Treffen Menschen immer die finale Entscheidung?

Wenn sich eine dieser Fragen unangenehm anfühlt, ist das ein Signal. Nicht unbedingt gegen die Technologie selbst – sondern dafür, dass sich die Erwartungen an ihren Einsatz deutlich verändert haben.

Wie wir bei VONQ darüber denken

Dieser Wandel hat uns intern zu ehrlicher Selbstreflexion gezwungen.

Nicht darüber, was KI kann – sondern darüber, was sie nicht tun sollte.

Ein Satz kam dabei immer wieder auf: Sobald KI beginnt, Einstellungsentscheidungen zu treffen, statt sie zu unterstützen, überschreiten wir eine Grenze. Nicht nur aus ethischer Sicht, sondern ganz pragmatisch. Denn was sich nicht erklären lässt, lässt sich nicht verteidigen. Und was sich nicht verteidigen lässt, hat im Enterprise-Umfeld keine lange Zukunft.

Also haben wir bewusst entschieden:

KI soll menschliches Urteilsvermögen verstärken, nicht ersetzen.

Ihre Aufgabe ist es, das Rauschen zu reduzieren, relevante Signale sichtbar zu machen und Arbeit zu übernehmen, die Menschen nicht leisten sollten – nicht Verantwortung auszulagern.

Diese Haltung hat geprägt, wie wir EQO entwickelt haben.

Statt eines einzigen intransparenten Modells im Hintergrund setzen wir auf spezialisierte KI-Agenten für einzelne Schritte: Screening, Interviews, Assessments, Scoring – immer innerhalb bestehender ATS-Workflows und immer mit Menschen, die den Prozess kontrollieren können und fest im Griff haben.

Die KI strukturiert Informationen, stellt Nachfragen, erkennt Muster und hebt Relevantes hervor. Entscheidungen werden weiterhin vom Recruiter getroffen.

Wir haben uns außerdem bewusst gegen eine weit verbreitete Logik entschieden: möglichst schnell aussortieren.

Viele Systeme sind auf Geschwindigkeit der Ablehnung optimiert. Unsere auf Qualität des Verstehens. Wenn etwas unklar ist, fragt das System nach. Wenn Potenzial da ist, aber noch nicht belegt, geht es dem nach.

Ziel ist nicht Geschwindigkeit um jeden Preis – sondern bessere Entscheidungen mit weniger Rätselraten.

Das ist kein philosophischer Ansatz. Das ist pragmatisch.

Je erklärbarer ein System ist, desto leichter lässt es sich kontrollieren und verantwortungsvoll einsetzen. Und Fragen von Aufsicht, Regulierung und Haftung gehören heute zu jeder Kaufentscheidung – ob Anbieter das mögen oder nicht.

Deshalb haben wir EQO früh unabhängigen Fairness- und Bias-Audits unterzogen – auch wenn das unbequem und aufwendig war. Nicht aus Marketing-Gründen, sondern weil wir sehen, welchem Prüfungsdruck Unternehmen zunehmend ausgesetzt sind.

Wenn KI in der Nähe von Hiring-Entscheidungen eingesetzt wird, reicht „Vertrauen Sie uns“ nicht mehr aus.

Wohin sich das alles entwickelt

Recruiting wird nie wieder vollständig menschlich sein – und das ist kein Verlust, sondern Fortschritt.

Was Prozesse entmenschlicht, ist nicht KI. Es sind Volumen, Überlastung und Systeme, die niemand erklären kann. Wenn Recruiter unter Zeitdruck hunderte Lebensläufe scannen müssen, verschwindet Bias nicht – er wächst.

Richtig eingesetzt kann KI das Recruiting sogar menschlicher machen: konsistenter, transparenter, nachvollziehbarer.

Deshalb werden in den kommenden Jahren diejenigen Organisationen vorne liegen, die früh auf verantwortungsvollen KI-Einsatz setzen. In dieser nächsten Phase des Recruitings sind Geschwindigkeit, Klarheit und Vertrauen keine netten Extras mehr – sie sind echte Wettbewerbsvorteile.

Die Systeme, die gewinnen, werden nicht die mit den spektakulärsten Demos sein. Es werden diejenigen sein, die in reale Organisationen passen, verantwortungsvoll skalieren – und ruhig bleiben können, wenn jemand fragt:

„Können Sie mir erklären, wie das funktioniert?“